Hva er Bayes teorem?

Bayes teorem er en oppskrift som skildrer hvordan man kan oppdatere sannsynlighetene for teorier når de får bevis. Det forfølger i utgangspunktet fra maksimene av betinget sannsynlighet, men det kan brukes til å kunne resonnere om et bredt omfang av problemer, inkludert overbevisning fornyelse.

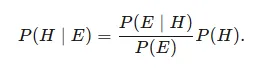

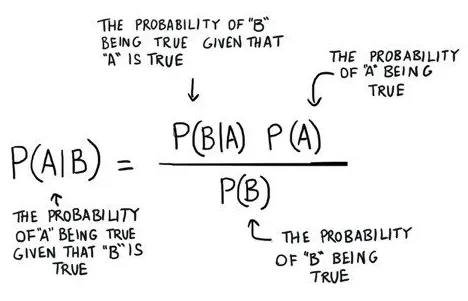

Gitt en teori H og bevis E, uttrykker Bayes teorem at sammenhengen mellom sannsynligheten for spekulasjonene før du får beviset P (H) og sannsynligheten for teorien i kjølvannet av å få beviset P (H∣E) er

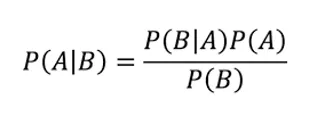

Det er et vakkert konsept av sannsynlighet hvor vi finner sannsynligheten når vi vet annen sannsynlighet

Som forteller oss: hvor regelmessig A skjer med tanke på at B oppstår, sammensatt P (A | B),

Når vi vet: hvor regelmessig B skjer, gitt at An oppstår, sammensatt P (B | A)

dessuten hvor sannsynlig An er uten noen andre, komponert P (A)

hva mer er, hvor sannsynlig B er uten noen andre, komponert P (B)

Eksempel på Bayes teorem

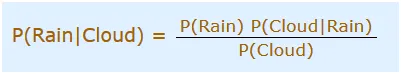

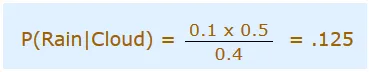

Du arrangerer en utflukt i dag, men morgenen er overskyet, Gud hjelper oss! halvparten av hver eneste stormfulle dag begynner lyssky! I alle fall er skyggefulle morgener normale (ca. 40% av dagene begynner overskyet). Videre er dette vanligvis en tørr måned (bare 3 av 30 dager vil generelt være stormende eller 10%). Hva er sannsynligheten for nedbør i løpet av dagen? Vi vil bruke regn til å bety nedbør i løpet av dagen, og sky til å bety overskyet morgen. Muligheten for Rain given Cloud er sammensatt av P (Rain | Cloud)

Så vi bør plassere det i ligningen:

- P (regn) Sannsynlighet for at det blir regn = 10% (gitt)

- P (Sky | regn) Sannsynlighet for at skyer er der og regn skjer = 50%

- P (Cloud) er sannsynligheten for at skyer er der = 40%

Så vi kan si at I c:

Det er Bayes teorem: at du kan utnytte sannsynligheten for en ting for å forutse sannsynligheten for noe annet. Likevel er Bayes teorem alt annet enn en statisk ting. Det er en maskin som du skifterøkkel for å forbedre og bedre prognoser som nye proof overflater. En spennende aktivitet er å fikle faktorene ved å legge ned karakteristiske teoretiske kvaliteter til P (B) eller P (A) og vurdere deres sammenhengende effekt på P (A | B). For eksempel, i tilfelle du øker nevneren P (B) til høyre, på dette punktet går P (A | B) ned. Solid modell: En rennende nese er en indikasjon på meslingene, men likevel er rennende nese unektelig mer typisk enn hudutslett med små hvite flekker. Det vil si at i tilfelle du velger P (B) der B er en rennende nese, på det tidspunktet avviser gjentakelsen av rennende nese i den samlede offentligheten muligheten for at rennende nese er en indikasjon på meslinger. Sannsynligheten for funn av meslinger går ned med hensyn til bivirkninger som blir gradvis normale; disse manifestasjonene er ikke solide tips. Når meslinger blir mer og mer normale og P (A) går opp i telleren til høyre, går P (A | B) vesentlig opp, med den begrunnelse at meslingene rett og slett ofte er mer sannsynlig å ta lite hensyn til bivirkningen som du vurderer.

Bruk av Bayes teorem i maskinlæring

Naive Bayes Classifier

Naive Bayes er en karakteriseringsberegning for doble (toklasse) og flerklasse grupperingsproblemer. Systemet er minst krevende å forstå når det er avbildet ved å bruke dobbel eller rett ut infokvaliteter.

Det kalles naive Bayes eller imbecile Bayes i lys av det faktum at beregningen av sannsynlighetene for hver teori strømlinjeformes for å gjøre antallet deres gjennomførbart. I motsetning til å forsøke å fastslå estimatene for hver trekkverdighet P (d1, d2, d3 | h), antas de å være begrensende frie gitt det målverdige og bestemmes som P (d1 | h) * P (d2 | H, etc.

Dette er en solid antagelse som er mest langsiktig i ekte informasjon, for eksempel om at egenskapene ikke kommuniserer. Av og til klarer metodikken sjokkerende resultater med informasjon der denne antakelsen ikke holder.

Skildring brukt av Naive Bayes modeller

Skildringen av en naiv Bayes-algoritme er sannsynligheten.

Sett med sannsynligheter blir satt bort for å begjære en vitenskapelig naiv bayesisk modell. Dette inkluderer:

Klassesannsynlighet: Sannsynligheten for alt i forberedelsesdatasettet.

Betinget sannsynlighet: Den betingede sannsynligheten for hver forekomst info verdt gitt hver klasse aktelse.

Ta inn en Naive Bayes-modell fra data. Det er raskt å ta inn en naiv bayesisk modell fra forberedelsesinformasjon. Forberedelsene skjer raskt i lys av det faktum at ensomhetsverdiene for hver forekomst av klassen og sannsynlighetsverdien for hver forekomst av klassen gitt særegne informasjonsverdier (x) skal bestemmes. Ingen koeffisienter skal være tilpasset av forbedringssystemer.

Regne ut sannsynligheter

En klassesannsynlighet er i utgangspunktet gjentakelsen av saker som har et sted med hver klasse isolert av det komplette antall saker.

For eksempel i en parallell klasse bestemmes sannsynligheten for at en sak har et sted med klasse 1 som:

Sannsynlighet (klasse = 1) = total (klasse = 1) / (total (klasse = 0) + total (klasse = 1))

I det mest enkle tilfellet har hver klasse en sannsynlighet på 0, 5 eller halvparten av et todelt klassifiseringsproblem med et tilsvarende antall forekomster i alle tilfeller av klassen.

Regne ut betinget sannsynlighet

De betingede sannsynlighetene er gjentakelsen av hver egenskap for en gitt klasse verdt delt opp ved gjentakelse av eksempler med den klasseskjønnet.

Alle anvendelser av Bayes teorem

Det er mange utnyttelse av Bayes teorem i virkeligheten. Forsøk ikke å stresse med sjansen for at du ikke ser all aritmetikken inkludert umiddelbart. Bare å få en følelse av hvordan den fungerer er tilstrekkelig til å begynne.

Bayesian Decision Theory er en målbar måte å håndtere spørsmålet om klassifisering av eksempler på. Under denne hypotesen er det forventet at den grunnleggende sannsynlighetsoverføringen for klassene er kjent. På denne måten skaffer vi oss en perfekt Bayes Classifier som alle andre klassifisere blir tatt en beslutning om utførelse mot.

Vi vil snakke om de tre grunnleggende bruksområdene av Bayes teorem:

- Naive Bayes 'klassifiserer

- Diskriminerende funksjoner og beslutningsoverflater

- Bayesianske parameterestimering

Konklusjon

Storslagenhet og intensitet av Bayes teorem slutter aldri å forundre meg. En grunnide, gitt av en prest som gikk over for mer enn 250 år tilbake, har sin bruk i de absolutt mest umiskjennelige AI-prosedyrene i dag.

Anbefalte artikler

Dette er en guide til Bayes teorem. Her diskuterer vi bruken av Bayes teorem i maskinlæring og skildringen som brukes av naive Bayes modeller med eksempler. Du kan også se på følgende artikler for å lære mer -

- Naive Bayes algoritme

- Typer maskinlæringsalgoritmer

- Maskinlæringsmodeller

- Læringsmetoder for maskiner