Hva er lineær regresjon i R?

Lineær regresjon er den mest populære og mye brukte algoritmen innen statistikk og maskinlæring. Lineær regresjon er en modelleringsteknikk for å forstå forholdet mellom inngangs- og utgangsvariabler. Her må variabler være numeriske. Lineær regresjon kommer fra det faktum at utgangsvariabelen er en lineær kombinasjon av inngangsvariabler. Utgangen er vanligvis representert med "y", mens inngangen er representert med "x".

Lineær regresjon i R kan kategoriseres på to måter

-

Si mple Lineær regresjon

Dette er regresjonen der utgangsvariabelen er en funksjon av en enkelt inngangsvariabel. Representasjon av enkel lineær regresjon:

y = c0 + c1 * x1

-

Flere lineære regresjoner

Dette er regresjonen der utgangsvariabelen er en funksjon av en variabel med flere innganger.

y = c0 + c1 * x1 + c2 * x2

I begge de ovennevnte tilfellene er c0, c1, c2 koeffisienten som representerer regresjonsvekter.

Lineær regresjon i R

R er et veldig kraftig statistisk verktøy. Så la oss se hvordan lineær regresjon kan utføres i R og hvordan dens utdataverdier kan tolkes.

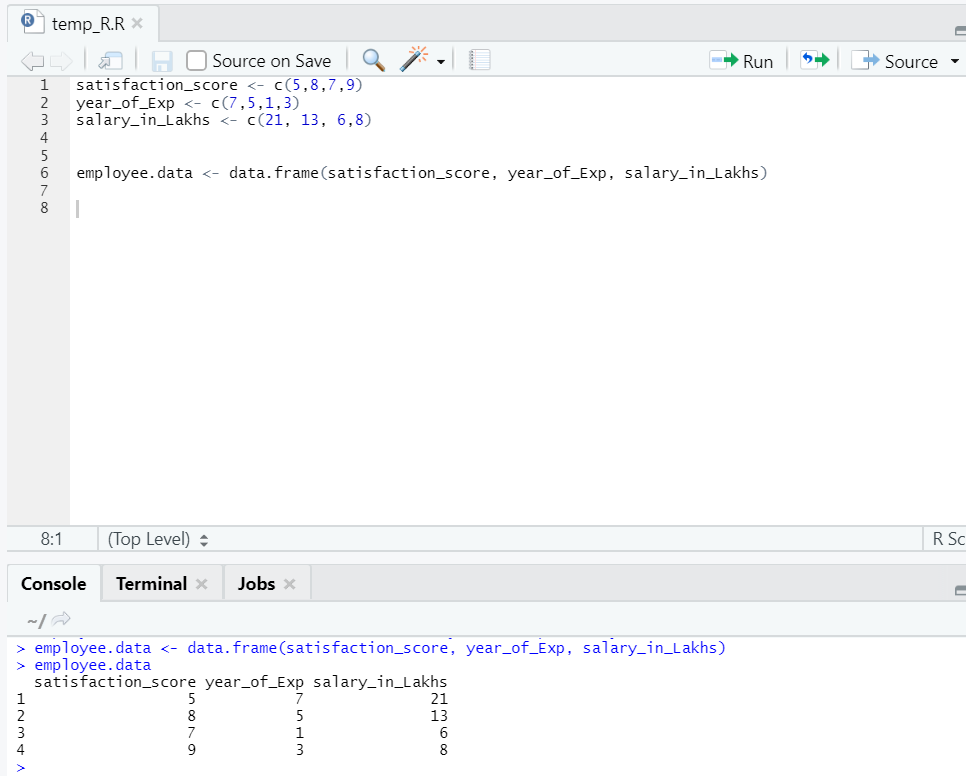

La oss utarbeide et datasett, for å utføre og forstå lineær regresjon i dybden nå.

Nå har vi et datasett, hvor "tilfredshet_score" og "year_of_Exp" er den uavhengige variabelen. "Lønn_in_lakhs" er outputvariabelen.

Med henvisning til datasettet ovenfor, er problemet vi ønsker å løse her gjennom lineær regresjon:

Beregning av lønnen til en ansatt, basert på hans års erfaring og tilfredshetsskår i selskapet hans.

R-kode for lineær regresjon:

model <- lm(salary_in_Lakhs ~ satisfaction_score + year_of_Exp, data = employee.data)

summary(model)

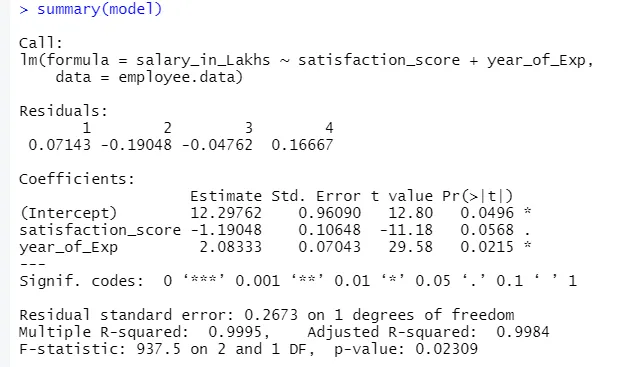

Utgangen til koden ovenfor vil være:

Formelen for regresjon blir

Y = 12, 29-1, 19 * tilfredshet = + 2, 08 × 2 * år_ av_Exp

I tilfelle har man flere innganger til modellen.

Da kan R-koden være:

modell <- lm (lønn_in_Lakhs ~., data = medarbeider.data)

Imidlertid, hvis noen ønsker å velge variabel ut av flere inndatavariabler, er det flere teknikker som "Backward Elimination", "Forward Selection" osv. Er tilgjengelige for å gjøre det også.

Tolkning av lineær regresjon i R

Nedenfor er noen tolkninger av lineær regresjon i r som er som følger:

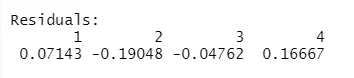

1.Residuals

Dette refererer til forskjellen mellom den faktiske responsen og den forutsagte responsen til modellen. Så for hvert punkt, vil det være en faktisk respons og en spådd respons. Derfor vil rester være så mange som observasjoner er. I vårt tilfelle har vi fire observasjoner, derav fire rester.

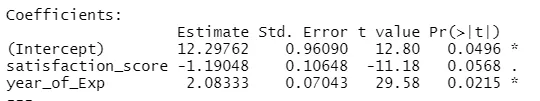

2.Coefficients

Hvis du går lenger, finner vi koeffisientdelen, som viser avskjæringen og skråningen. Hvis man ønsker å forutsi lønnen til en ansatt ut fra sin erfaring og tilfredshetsscore, må man utvikle en modellformel basert på helning og avskjæring. Denne formelen vil hjelpe deg med å forutsi lønn. Avskjæringen og skråningen hjelper en analytiker til å komme frem til den beste modellen som passer datapunkter passende.

Helling: Viser bratthet på linjen.

Avskjæring: Plasseringen der linjen skjærer aksen.

La oss forstå hvordan formelformasjon gjøres basert på helning og avskjæring.

Si at avskjæring er 3 og skråningen er 5.

Så formelen er y = 3 + 5x . Dette betyr at hvis x økes med en enhet, blir y økt med 5.

a.Coefficient - Estimate

I dette betegner avlyttingen gjennomsnittsverdien til utgangsvariabelen, når all inngang blir null. Så, i vårt tilfelle, vil lønnen i lakhs være 12, 29 lakhs som gjennomsnittlig med tanke på tilfredshetspoeng og erfaring kommer null. Her representerer skråningen endringen i utgangsvariabelen med en enhetsendring i inngangsvariabelen.

b.Koeffisient - Standardfeil

Standardfeilen er estimering av feil, som vi kan få når vi beregner forskjellen mellom den faktiske og forutsagte verdien av responsvariabelen vår. Dette forteller i sin tur om tilliten til relatert input og output variabler.

c.Koeffisient - t verdi

Denne verdien gir tillit til å avvise nullhypotesen. Jo større verdi fra null er, jo større er tilliten til å avvise nullhypotesen og etablere forholdet mellom output og input variabel. I vårt tilfelle er verdien også borte fra null.

d.koeffisient - Pr (> t)

Dette forkortelsen skildrer i utgangspunktet p-verdien. Jo nærmere det er null, jo lettere kan vi avvise nullhypotesen. Linjen vi ser i vårt tilfelle, denne verdien er nær null, vi kan si at det eksisterer en sammenheng mellom lønnspakke, tilfredshetsscore og år med erfaringer.

Reststandardfeil

Dette skildrer feilen i prediksjonen av responsvariabelen. Jo lavere den er, jo høyere er nøyaktigheten til modellen.

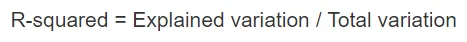

Flere R-kvadrater, Justert R-kvadrat

R-kvadrat er et veldig viktig statistisk tiltak for å forstå hvor nær dataene har passet inn i modellen. Derfor i vårt tilfelle hvor godt modellen vår som er lineær regresjon representerer datasettet.

R-kvadratverdien ligger alltid mellom 0 og 1. Formelen er:

Jo nærmere verdien er 1, jo bedre beskriver modellen datasettene og dens varians.

Når mer enn en inngangsvariabel kommer inn i bildet, foretrekkes imidlertid den justerte R-kvadratverdien.

F-statistikk

Det er et sterkt tiltak for å bestemme forholdet mellom input og responsvariabel. Jo større verdi enn 1, jo høyere er tilliten til forholdet mellom inngangs- og utgangsvariabelen.

I vårt tilfelle er det “937, 5”, som er relativt større med tanke på størrelsen på dataene. Derfor blir avvisningen av nullhypotesen lettere.

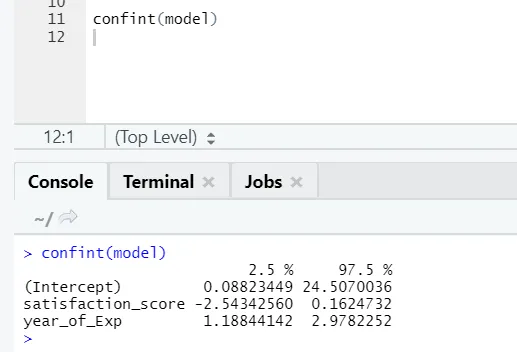

Hvis noen ønsker å se tillitsintervallet for modellens koeffisienter, er her måten å gjøre det på: -

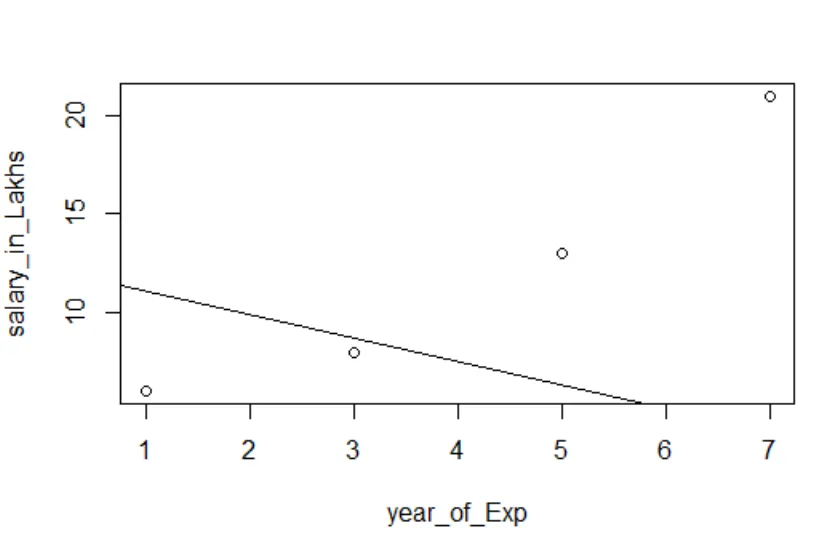

Visualisering av regresjon

R-kode:

plot (lønn_in_Lakhs ~ tilfredshet_score + år_of_Exp, data = medarbeider.data)

abline (modell)

Det er alltid bedre å samle flere og flere poeng før du passer på en modell.

Konklusjon - Lineær regresjon i R

Lineær regresjon er enkel, enkel å passe, lett å forstå, men likevel veldig kraftig modell. Vi så hvordan lineær regresjon kan utføres på R. Vi prøvde også å tolke resultatene, noe som kan hjelpe deg i optimaliseringen av modellen. Når man blir komfortabel med enkel lineær regresjon, bør man prøve multippel lineær regresjon. Sammen med dette, ettersom lineær regresjon er følsom for outliers, må man se nærmere på den, før man hopper direkte inn i passningen til lineær regresjon.

Anbefalte artikler

Dette er en guide til Lineær regresjon i R. Her har vi diskutert hva som er lineær regresjon i R? kategorisering, visualisering og tolkning av R. Du kan også gå gjennom våre andre foreslåtte artikler for å lære mer -

- Prediktiv modellering

- Logistisk regresjon i R

- Decision Tree i R

- R Intervjuespørsmål

- Topp forskjeller av regresjon vs klassifisering

- Guide to Decision Tree in Machine Learning

- Linear Regression vs Logistic Regression | Topp forskjeller