Forskjeller mellom veiledet læring vs dyp læring

Forskjeller mellom veiledet læring vs dyp læring

I veiledet læring inkluderer treningsdataene du mater til algoritmen de ønskede løsningene, kalt etiketter. En typisk veiledet læringsoppgave er klassifisering. Spamfilteret er et godt eksempel på dette: det er opplært med mange eksempler på e-post sammen med klassen deres (spam eller skinke), og den må lære å klassifisere nye e-poster.

Dyp læring er et forsøk på å etterligne aktiviteten i lag av nevroner i neocortex, som er omtrent 80% av hjernen der tenking skjer (I en menneskelig hjerne er det rundt 100 milliarder nevroner og 100 ~ 1000 billioner synapser). Det kalles dypt fordi det har mer enn ett skjult lag av nevroner som bidrar til å ha flere tilstander med ikke-lineær funksjonstransformasjon

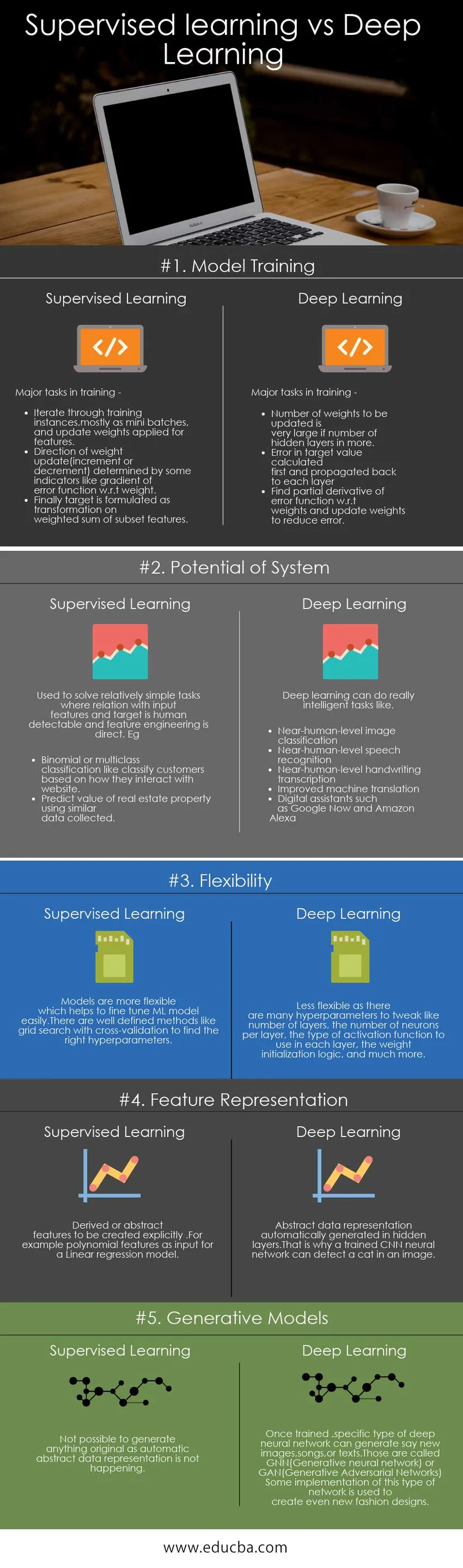

Sammenligning av hodet mot hodet av veiledet læring vs dyp læring (infografikk)

Nedenfor er Topp 5-sammenligningen mellom veiledet læring og dyp læring

Viktige forskjeller mellom veiledet læring vs dyp læring

Både Supervised Learning vs Deep Learning er populære valg i markedet; la oss diskutere noen av de viktigste forskjellene mellom veiledet læring og dyp læring:

● Store modeller -

Viktige modeller under tilsyn er -

○ k-Nærmeste naboer - Brukes for klassifisering og regresjon

○ Lineær regresjon - For prediksjon / regresjon

○ Logistisk regresjon - for klassifisering

○ Support Vector Machines (SVMs) - Brukes for klassifisering og regresjon

○ Beslutningstrær og tilfeldige skoger - Både klassifiserings- og regresjonsoppgaver

Mest populære Deep neurale nettverk:

● Multilayer Perceptrons (MLP) - Mest grunnleggende type. Dette nettverket er vanligvis startfasen for å bygge et annet mer sofistikert dypt nettverk og kan brukes til alle kontrollerte regresjons- eller klassifiseringsproblemer

● Autoencoders (AE) - Nettverk har uovervåket læringsalgoritmer for funksjonslæring, dimensjonsreduksjon og spissdetektering

● Convolution Neural Network (CNN) - spesielt egnet for romlige data, objektgjenkjenning og bildeanalyse ved bruk av flerdimensjonale nevronstrukturer. En av hovedårsakene til populariteten til dyp læring den siste tiden skyldes CNN.

● Recurrent Neural Network (RNN) - RNNs brukes for sekvensert dataanalyse som tidsserier, sentimentanalyse, NLP, språkoversettelse, talegjenkjenning, bildeteksting. En av de vanligste typene RNN-modeller er LSTM-nettverk (Long Short-Term Memory).

● Treningsdata - Som nevnt tidligere trenger overvåkede modeller treningsdata med etiketter. Men Deep learning kan håndtere data med eller uten etiketter. Noen nevrale nettverksarkitekturer kan ikke overvåkes, for eksempel autokodere og begrensede Boltzmann-maskiner

● Funksjonsvalg - Noen overvåkede modeller kan analysere funksjoner og velge et delmengde av funksjonen for å bestemme målet. Men mesteparten av tiden må dette håndteres i dataforberedelsesfasen. Men i Deep Neural Networks dukker det opp nye funksjoner, og uønskede funksjoner blir kastet når læringsfremgangen går.

● Datarepresentasjon - I klassiske overvåkede modeller opprettes ikke abstraksjon på høyt nivå av inngangsfunksjoner. Endelig modell som prøver å forutsi output ved å anvende matematiske transformasjoner på en undergruppe av inputfunksjoner.

Men i dype nevrale nettverk dannes abstraksjoner av inputfunksjoner internt. For eksempel, mens oversettelse av tekst, konverterer nevrale nettverket først inngangstekst til intern koding og transformerer deretter den abstrakte representasjonen til målspråk.

● Framework - Overvåket ML-modeller støttes av mange generiske ML-rammer på tvers av forskjellige språk - Apache Mahout, Scikit Learn, Spark ML er noen av disse.

Majority Deep læringsrammer gir en utvikler-vennlig abstraksjon for å lage et nettverk enkelt, ta vare på distribusjon av beregning og har støtte for GPUs.Caffe, Caffe2, Theano, Torch, Keras, CNTK, TensorFlow er populære rammer. Tensorflyt fra Google er mye brukt nå med aktiv samfunnsstøtte.

Supervised Learning vs Deep Learning Comparison tabell

Nedenfor er noen nøkkelsammenligning mellom Supervised Learning vs Deep Learning

| Grunnlaget for sammenligning mellom veiledet læring og dyp læring | Veiledet læring | Dyp læring |

| Modelltrening | Store oppgaver i trening -

| Store oppgaver i trening -

|

| Potensial til systemet | Brukes til å løse relativt enkle oppgaver der forhold til inngangsfunksjoner og mål er menneskelig detekterbar og funksjonsteknikk er direkte. F.eks:

| Dyp læring kan gjøre virkelig intelligente oppgaver som

|

| fleksibilitet | Modellene er mer fleksible, noe som hjelper deg med å finjustere ML-modellen enkelt. Det er veldefinerte metoder som ridesøk med kryssvalidering for å finne de riktige hyperparametrene | Mindre fleksibel fordi det er mange hyperparametre å finpusse som et antall lag, antall nevroner per lag, typen aktiveringsfunksjon som skal brukes i hvert lag, vektinitieringslogikken og mye mer. |

| Funksjon Representasjon | Avledede eller abstrakte funksjoner som skal opprettes eksplisitt. For eksempel polynomfunksjoner som input for en lineær regresjonsmodell | Abstrakt datarepresentasjon genereres automatisk i skjulte lag. Det er grunnen til at et trent CNN-nevralt nettverk kan oppdage en katt i et bilde. |

| Generative modeller | Ikke mulig å generere noe originalt da automatisk abstrakt datarepresentasjon ikke skjer | Når den er trent, kan en spesifikk type dypt nevralt nettverk generere si nye bilder, sanger eller tekster. De kalles GNN (Generative neurale nettverk) eller GAN (Generative Adversarial Networks)

Noe implementering av denne typen nettverk brukes til å lage enda nye motedesign |

Konklusjon - Supervised Learning vs Deep Learning

Nøyaktighet og evne til DNN (Deep Neural Network) har økt mye de siste årene. Derfor er DNN-er et område med aktiv forskning, og vi tror, det har potensial til å utvikle et generelt intelligent system. Samtidig er det vanskelig å resonnere hvorfor et DNN gir en bestemt utgang som gjør finjustering av et nettverk virkelig vanskelig. Så hvis et problem kan løses ved bruk av enkle ML-modeller, anbefales det på det sterkeste å bruke det. På grunn av dette faktum vil en enkel lineær regresjon ha relevans selv om det utvikles et generelt intelligent system ved bruk av DNN-er.

Anbefalt artikkel

Dette har vært en guide til de viktigste forskjellene mellom Supervised Learning vs Deep Learning. Her diskuterer vi også Supervised Learning vs Deep Learning sentrale forskjeller med infografikk og sammenligningstabell. Du kan også se på følgende artikler -

- Veiledet læring vs forsterkningslæring

- Supervised Learning vs Unsupervised Learning

- Neural Networks vs Deep Learning

- Machine Learning vs Predictive Analytics

- TensorFlow vs Caffe: Hva er forskjellene

- Hva er veiledet læring?

- Hva er forsterkningslæring?

- Topp 6 sammenligninger mellom CNN vs RNN